L a metà delle visite ai siti web di tutto il mondo viene effettuata da robot. Sono robot i destinatari della metà di tutta la pubblicità sul web. Sempre i robot inviano un quarto dei tweet e dei messaggi via chat, così come 20 milioni di richieste sul sito di appuntamenti Ashley Madison. Mentre economisti e imprenditori discutono sull’opportunità di attribuire ai robot un salario o almeno un 730, loro intanto si sono presi il nostro computer e lo usano per comunicare. Finora, però, il massiccio intervento degli automi non ha portato ordine nella nostra vita online e offline. Un articolo appena pubblicato dalla rivista Plos One intitolato “Anche i bravi robot litigano: l’esempio di Wikipedia” contiene forse la spiegazione di questo paradosso: quando interagiscono, anche i robot più semplici danno vita a comportamenti collettivi complessi e imprevedibili che riflettono la cultura di origine di chi li ha progettati.

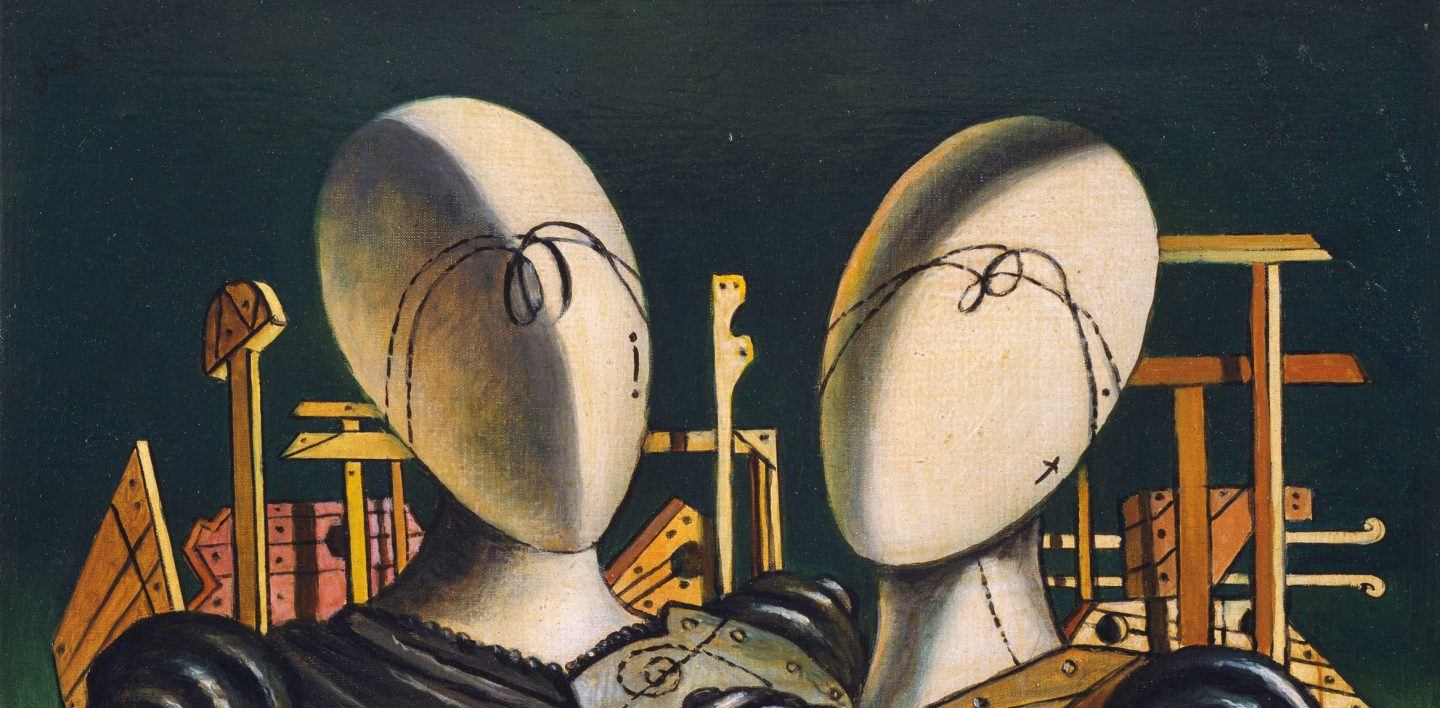

Lo studio è stato realizzato da un gruppo di ricercatori dell’università di Oxford guidati dall’iraniano Taha Yasseri e dall’italiano Luciano Floridi. In Inghilterra, Floridi insegna da molti anni “filosofia ed etica dell’informazione”, una nuova branca della filosofia morale dedicata allo studio del comportamento dei computer e dei robot. È un campo fortemente interdisciplinare: la ricerca sui robot, ad esempio, è firmata anche dalla sociologa Milena Tsvetkova e dall’informatica Ruth Garcia. Quando si parla di robot, però, non bisogna immaginare i manichini di lamiera di Guerre Stellari. “Quelli che navigano tra un sito e l’altro sono robot virtuali, semplici software da poche righe di codice”, spiega Floridi. Nel gergo di Internet, robot di questo tipo sono generalmente abbreviati in “bot”. Vengono progettati per eseguire senza stancarsi azioni ripetitive come cercare le parole chiave su un sito internet o analizzare i profili degli utenti dei social network.

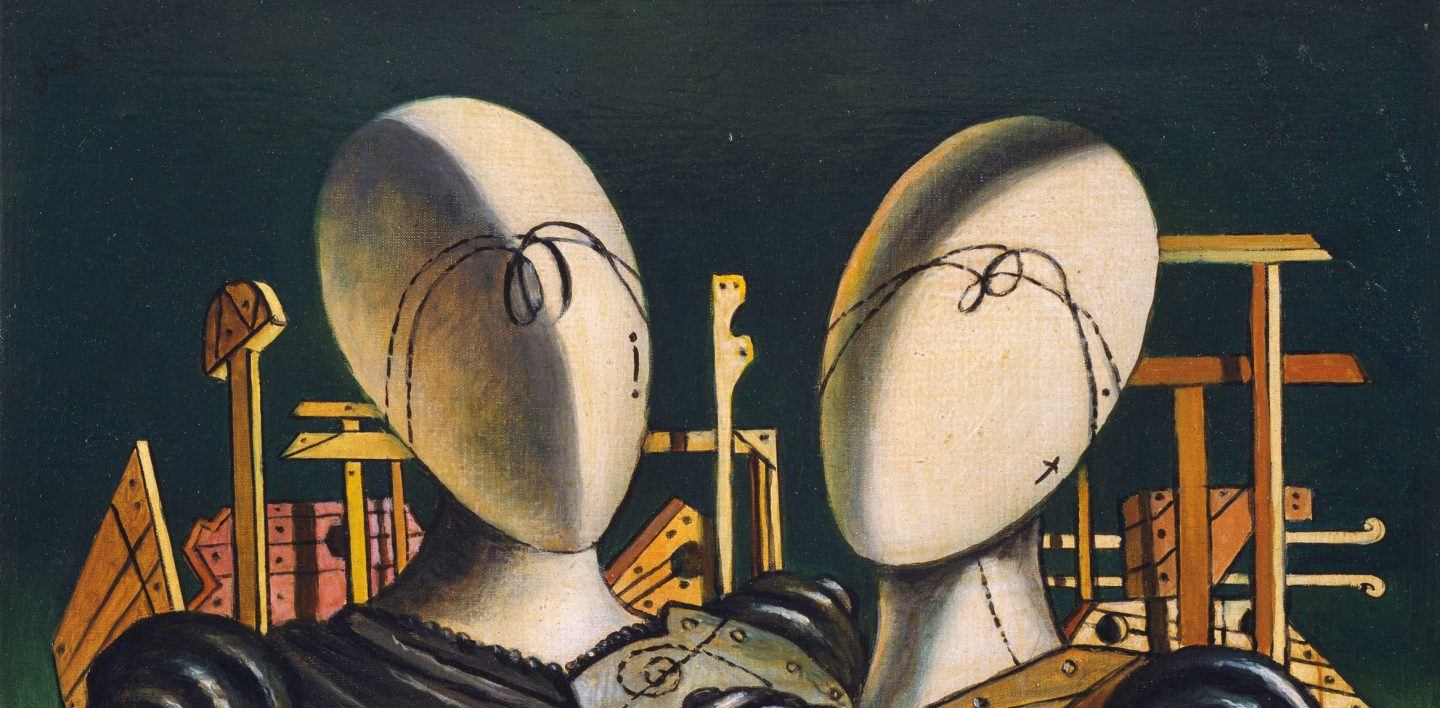

Quando interagiscono tra loro, anche i robot più semplici danno vita a comportamenti collettivi complessi e imprevedibili.

I bot possono essere divisi in “buoni” e “cattivi”. I primi ci aiutano a classificare i siti e a segnalare quelli illeciti, gli altri si occupano di missioni meno nobili – registrare i nostri dati personali, riempirci la mail di spam o truccare i dati delle visite per ingannare le agenzie pubblicitarie. Floridi e colleghi si sono occupati di un particolare gruppo di bot: quelli che aiutano Wikipedia a mantenere buoni standard di accuratezza nelle informazioni pubblicate. L’enciclopedia online è composta da oltre 43 milioni di voci (in tutte le lingue) che qualunque utente può modificare. Per le migliaia di amministratori del sito, tenere sotto controllo una tale mole di pagine sarebbe impossibile senza l’aiuto di circa 1500 bot che si occupano di correggere l’ortografia e la formattazione degli articoli, creare link utili per il lettore, segnalare informazioni false. A loro si deve una percentuale sostanziale delle modifiche effettuate: si tratta del 10% circa nelle versioni in inglese o in tedesco, ma arriva alla metà delle modifiche nella versione araba e in quella persiana.

I bot spesso non sono d’accordo tra loro. “Capita che un bot cancelli una modifica effettuata da un altro bot. A sua volta, il bot intervenuto per primo ripete la modifica. Nascono così liti tra bot che possono durare anni, intorno allo spelling di una parola o al link più corretto per un dato argomento. Finché un amministratore non interviene a staccare la spina”, spiega Floridi.

Nel periodo studiato dai ricercatori (2001-2010), ogni bot della Wikipedia inglese in media ha cancellato un centinaio di modifiche effettuate da altri bot (tra gli editor umani questo succede in media solo tre volte). La litigiosità cambia da nazione a nazione. In media, ciascun bot tedesco ha cancellato solo 24 modifiche di altri bot. Tra i bot portoghesi, i più cocciuti, questo numero sale a 185. Niente male, per automi che dovrebbero facilitare la collaborazione. Ma anche le migliori intenzioni possono fallire, quando si passa dagli individui alla popolazione. “I risultati dimostrano che, anche se in termini numericamente diversi, i bot di Wikipedia si comportano e interagiscono con la stessa imprevedibilità e inefficienza degli umani”, scrivono gli autori della ricerca.

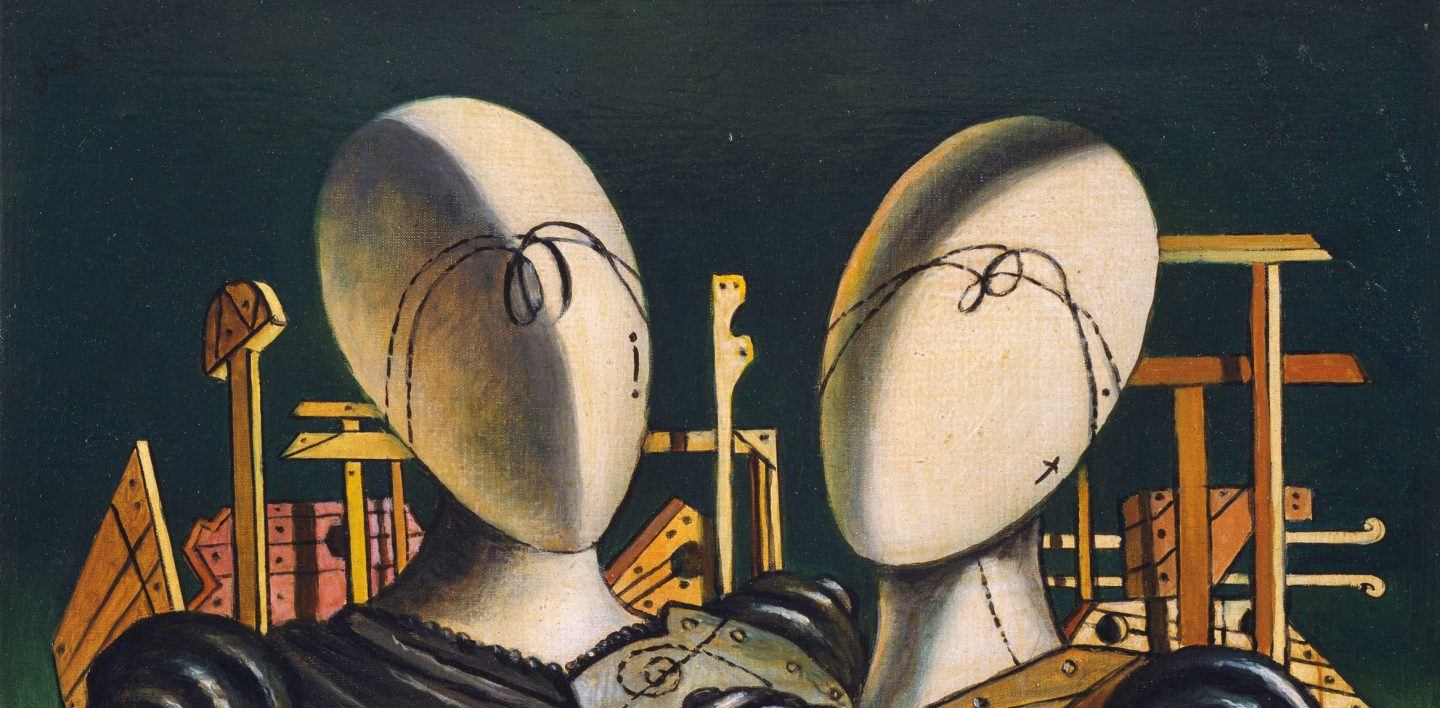

In molti settori, i robot hanno già occupato il centro della scena: dopo la comunicazione via web e la finanza, la prossima frontiera è quella dei trasporti.

È una lezione importante, in un mondo che sempre più spesso si affida ai robot per l’ordinaria amministrazione dei sette miliardi di abitanti del pianeta. La prossima frontiera sarà quella dei trasporti: tutti i maggiori gruppi industriali dell’high tech stanno progettando modelli di auto a guida autonoma in grado di evitare pedoni, buche e altri veicoli grazie all’intelligenza artificiale. Secondo gli analisti della società di ricerca e consulenza IHS, nel 2035 si venderanno nel mondo 21 milioni di automobili a guida autonoma, fino a diventare la maggioranza dei veicoli in circolazione. In altri settori, i robot hanno già occupato il centro della scena. Non solo nella comunicazione via web, spesso mediata da bot che filtrano notizie e amicizie sulla base dei nostri profili, ma anche nella finanza, dove l’epoca dei “lupi” di Wall Street è finita da un pezzo. Il cosiddetto “automated trading” (software in grado di comprare e vendere titoli nel giro di millisecondi), infatti, è responsabile dei tre quarti degli scambi azionari alla borsa di New York già dal 2014. E di un paio di “flash crash”, rapidissimi crolli dei prezzi delle azioni spesso (non sempre) seguiti da recuperi altrettanto repentini.

Come mostra la ricerca di Floridi e colleghi, una popolazione non è la semplice somma degli individui, anche se si tratta di macchine. Quando le auto autonome diventeranno più numerose, la loro interazione potrebbe generare comportamenti imprevisti e potenzialmente pericolosi, anche se nella progettazione delle singole auto fosse adottata la massima cautela. Capire quali regole di convivenza si daranno i robot non sarà solo un affare da ingegneri. “Dato che i bot saranno sempre più numerosi e sofisticati, le scienze sociali dovranno impegnarsi sempre di più per comprenderne la vita sociale e la cultura”, sostengono i ricercatori di Oxford nelle conclusioni del loro articolo.

Oggi si parla già molto del possibile immediato utilizzo dei bot per filtrare le fake news e l’hate speech delle conversazioni sui social networks. Floridi, però, ha qualche dubbio a riguardo. “Affidarsi ai bot creerebbe un ulteriore livello di opacità: certamente avremmo accesso a informazione selezionata, ma non sarebbe chiaro da chi e in base a quali criteri. Meglio il caos attuale, nonostante la fatica necessaria per orientarsi”. Ma allora, prima di affidar loro tutti i nostri lavori, non sarebbe meglio assicurarci che questi robot meritino davvero un salario? L’errore consiste nell’opporre l’umano e il robot, secondo il filosofo. “Cito spesso l’esempio degli scacchi, in cui ogni tanto si fanno gareggiare i computer contro maestri in carne ed ossa. Qualche volta vince l’uomo, altre volte la macchina. Ma un maestro di scacchi aiutato da un computer sarebbe veramente imbattibile”.